-

활성화 함수 - 소프트맥스 함수 (Softmax function) 란?Deep Learning (DL) 2022. 10. 29. 02:50

활성화 함수(Activation function)

활성화 함수는 가중 합의 출력 값이 입력되었을 때, 그대로 출력 하지 않고

값을 증폭 시키거나, 감소 시키는 등 얼마 만큼의 신호로 출력 할 지 정해주는 함수이다.

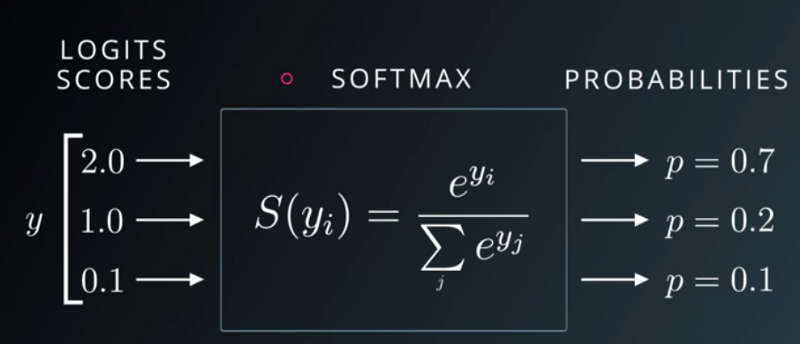

4. 소프트맥스 함수 (Softmax function)

시그모이드 함수와 유사한 함수이다.

단,

시그모이드 함수는 2진 분류 문제에 적합하였다면,

소프트맥스 함수는 다중 분류 문제에 적용할 수 있도록 시그모이드 함수를 일반화 한 함수이다.

가중 합 값을 소프트맥스 함수에 통과 시키면,

모든 클래스 값의 합이 1이 되는 확률 값 으로 변환된다.

'Deep Learning (DL)' 카테고리의 다른 글

활성화 함수 - ReLU 함수 (ReLU function) 란? (0) 2022.10.29 활성화 함수 - 시그모이드 함수(Sigmoid function) 란? (0) 2022.10.29 활성화 함수 - 계단 함수 (Step function) 란? (0) 2022.10.29 퍼셉트론의 도식화 (Feat. 가중치, 가중합) (0) 2022.10.28 퍼셉트론 (Perceptron) 이란? (0) 2022.10.27